Um das Tastmodell eines Waldmistkäfers zum Sprechen zu bringen, kombinierten wir eine Software zur Gestenerkennung mit taktiler Sensorik.

Angestoßen wurde das Forschungsprojekt durch die systematische Sammlungserschließung des Museums, bei der Teile der Insektensammlung digital erfasst werden. Als Inspiration dienten die Tast-Erlebnistouren des MfN, bei denen blinde und sehbehinderte Besucher*innen auf taktile Entdeckungsreise gehen. Die Kollektion der eingesetzten Tastobjekte wird nun durch ein hochskaliertes Insekten-Tastobjekt ergänzt.

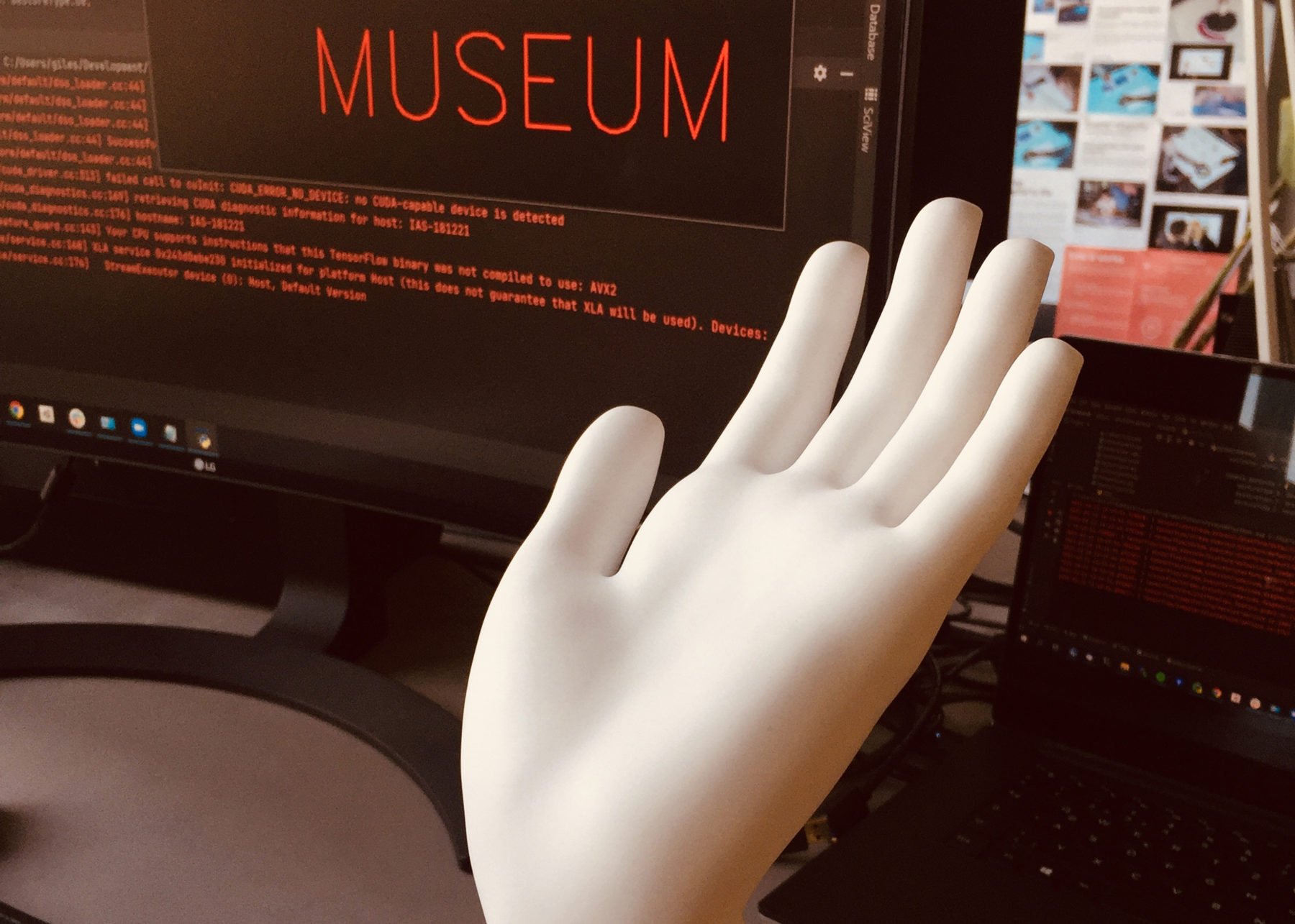

Für die Umsetzung des Tastmodells eines Waldmistkäfers aus der entomologischen Sammlung statteten wir die gesamte Oberfläche des Käfers mit einer Sensorik aus, die Gesten erkennt und Audio-Inhalte abspielt.

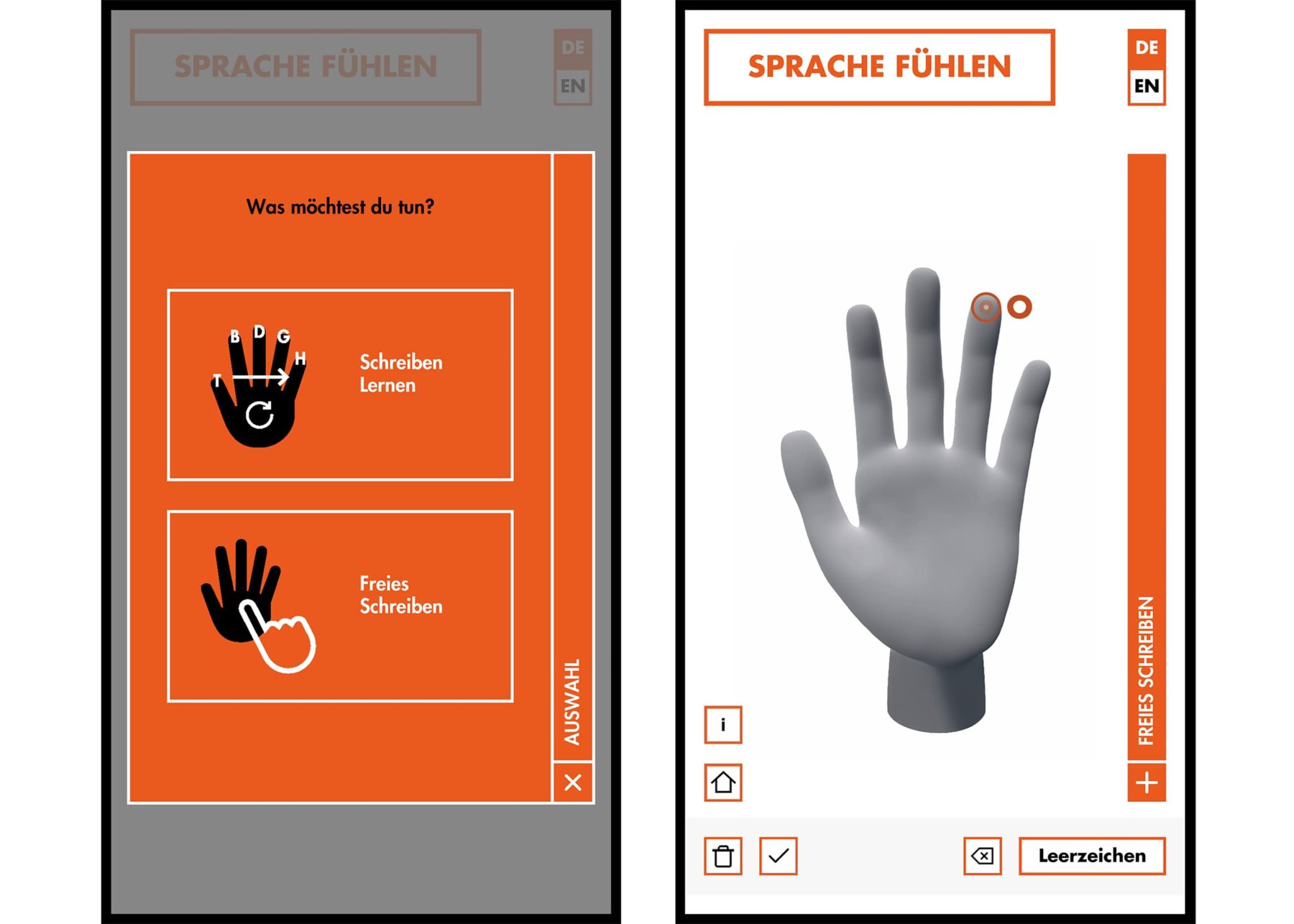

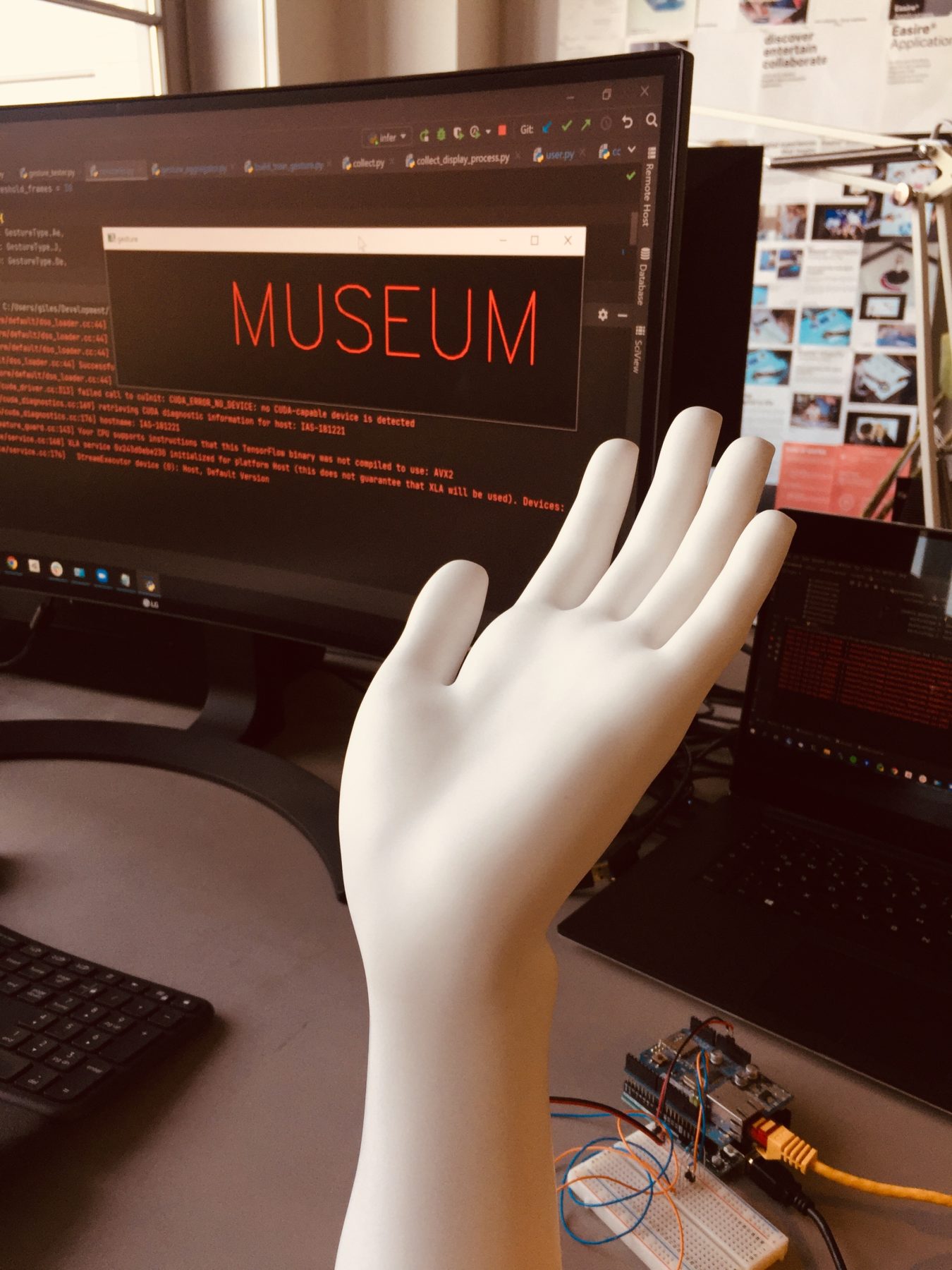

Dass taktile Modelle auch mithilfe von KI zu interaktiven Steuerelementen werden können, zeigten wir bereits 2021 am Exponat der Lormhand.

Wie das funktioniert?

Mehr erfahren